AI戦略会議などから考える、生成AIの可能性やリスクとは?

ChatGPTをはじめとした生成AIが、世界的に注目されています。日本に限らず世界の人々が、この新しいテクノロジーに秘められた可能性に大きな期待と不安を抱いている状況です。この記事では生成AIとは何かについて振り返った上で、日本や世界の生成AIに対する考え方や対応について解説します。あわせてHyper Islandの創立者であるジョナサン・ブリッグス氏が考えるAI戦略についてもご紹介いたします。

生成AI(ジェネレーティブAI)とは

生成AIとは指示文(プロンプト)に基づき、テキストや画像、動画をはじめとした様々なコンテンツを0から作り出せる学習能力を備えたAIのことです。生成AIはジェネレーティブAI(Generative AI)とも呼ばれ、代表的な種類としてAIチャットボット「ChatGPT」や画像生成AI「Midjourney」などが挙げられます。

生成AIは文章や画像の作成など、人間がコンピューター上で行ってきた様々な作業を実行可能です。さらに生成AIは、これらの作業を人間が行うよりずっと早く完了させることができます。

生成AIと従来からあるAIとの違いは?

従来のAIは、識別系AIとも言われ、あらかじめ大量のデータを与えて学習させた上で、入力されたデータが正解か不正解かなどを推測することが役割です。期待される主な用途として、文字認識・画像認識・需要予測などが挙げられます。またあらかじめ決められた作業を自動化するなど、業務の効率化にも大きく貢献してきました。

一方で生成AIは、プロンプトに基づきクリエイティブに新しいコンテンツを生成することが目的です。生成AIは従来のAIと違い、これまで人間しかできないとされてきた、学習した内容に基づいて自ら考えてコンテンツを作り上げる行為を実現できるようになりました。

日本のAI戦略の概要

生成AIの登場は、日本に大きな影響を及ぼす可能性があります。そんな生成AIに対する、日本の対応を取り決める重要な役割を果たすのがAI戦略会議です。以下、AI戦略会議の概要や、日本のAIに対する戦略・取り組みについてみていきましょう。

AI戦略会議とは

「AI戦略会議」とは、日本のAI活用や政策に関わる司令塔の役割を果たす政府の有識者会議です。AI戦略会議は総理や関係閣僚、有識者によって構成されており、初回の会合が2023年5月に開催されています。これまで日本では「AI戦略実行会議」において、技術面を中心にAIに関わる議論が行われてきました。AI戦略会議は、AI戦略実行会議を改装・拡張したものです。

AI戦略実行会議では有識者と官僚のみで構成されていましたが、AI戦略会議となり大臣や総理といった政治家も参加するようになっています。AIが日本にとって、それだけ重要な存在として認識されるようになった現れといえるでしょう。

AIに関する論点整理(2023年5月末時点)

AI戦略会議では、生成AIに関する論点を「AI に関する暫定的な論点整理」(2023年5⽉26⽇公開)というドキュメントにまとめています。本ドキュメントの冒頭では、⽣成 AI について、

『変⾰の時代を呼び起こし、新しい⾃由を⼈に与えてくれそうな勢いと技術的背景がある』

と評価した上で、具体的に⽣成AIによる変化で困難に直⾯している⽅も出てきているとし、

『こうした⽅にしっかりと寄り添い、国⺠の 声に応え、懸念やリスクを低減する措置を同時に講じていくことも⼤変重要である。技術や成⻑の話をするばかりでなく、しっかりと懸念やリスクへの対応とのバランスを取りながら進めていく必要がある。』

とあります。

また、日本はテクノロジー関連における研究・技術水準が極めて高い点、どのような入力をするか創意工夫が必要である生成AIの利用において日本人が向いているという意見がある点、日本人は一人ひとりが創造的で、きめ細やかなものを作り上げられる点を挙げ、日本と生成AIの親和性が高く、充分に世界で活躍できる可能性があるとしています。

『ここ30 年来、成⻑の機会を逃し続けてきた感のある⽇本においても、変⾰の時代は⼤きなチャンスの到来である』

とある通りです。

以下、本ドキュメントの要旨をみていきましょう。

AI利用の意義と必要な取り組み

デジタル社会の実現に向け、行政・企業・教育・医療機関などで、デジタル技術の活用やDX促進の取り組みが進められている状況です。こうした中、生成AIを含むAIは社会のデジタル化を加速させ、生産性向上にとどまらず様々な社会課題解決に役立つ可能性があります。AI利用を加速させるため、AIがデータを学習する前提となるようなデータ連携基盤の構築が極めて重要です。またデジタル人材の育成・確保、スタートアップ創出を促進するための事業環境の整備も求められます。

懸念されるリスクの具体例と対応

AIにより、以下にあげるリスクが懸念されるとしています。

・機密情報の漏えいや個人情報の適切でない利用

AIとの対話によりユーザーの機密情報が漏えいしたり、個人情報が不適切に利用されたりするリスクがある。AI開発者やAIサービスの提供者はデータの取り扱いなどを開示し、透明性・信頼性を高めることが求められる。また利用者側も、このリスクにどう対処すべきか対応の在り方について検討する必要がある。

・犯罪がより容易に、より巧妙になる

生成AIを悪用することで、犯罪がより容易に行われたり、より巧妙になったりするリスクがある。現行の法整備はもちろん、ガイドライン・体制に不備があると考えられる場合は、諸外国の例などを参考に整備する必要がある。またAIが不正に利用されないよう、AIの不適切な回答を抑制するプログラムの開発も望ましい。

・偽情報の流布により社会が混乱する

生成AIにより、本物と見分けがつかない偽情報を誰でも簡単に作れるようになる。これら偽情報を流布することで、社会が混乱するリスクが生じる。現行の法整備はもちろん、ガイドライン・体制に不備があると考えられる場合は、諸外国の例などを参考に整備する必要がある。またAIが生成した情報か否かを、判別するソフトウェアの開発などが求められる。

・サイバー攻撃の巧妙化

AIの悪用によってサイバー攻撃が巧妙化し、防御が難しくなる恐れがある。政府は適宜サイバー攻撃の情報を収集し、必要に応じて周知するなどの対策が求められるのではないか。またAIを活用したセキュリティ対策も求められるのではないか。

・教育の品質低下

たとえば宿題をAIで解くなど、生徒がAIを不適切に利用することで教育の品質が低下する恐れがある。AIリテラシーの教育が重要となり、必要に応じて専用の教育項目を追加するなどの措置も求められる。

・著作権の侵害

AIがオリジナルと見分けがつかない著作物を生成する可能性がある。政府は著作権法制度について丁寧に周知する必要がある。またオリジナル権利者の利害を阻害しないようにするための対応を検討する必要がある。

失業者の増加

AIが人間の作業を代替することにより、失業者が増加する懸念がある。政府はAIが雇用に与える影響について情報を収集し、適宜必要な対応を実行する必要がある。またAIに仕事を奪われた失業者が新たな働き方をみつけられるよう、リスキリングなどの対策も検討する必要がある。

これらリスク対応の前提としてAI開発者などが自らリスク評価し、ガバナンス機能を発揮することが求められます。その上で必要に応じ、政府などによる対応の検討も必要です。

AI開発力強化に向けた取り組みについて

AIは目まぐるしいスピードで、技術革新が進んでいる状況です。AI開発に適宜関与せず最先端の技術情報にアクセスする機会を失えば、それ自体が大きなリスクにつながります。生成AIに関連した基盤的な研究力・開発力を、速やかに醸成することが必要です。

また政府がAIの開発支援を行う場合、AI開発のインフラとなる計算資源やデータの整備・拡充が最も重要です。その一方で、生成AI自体の開発にはスピード感が求められます。政府の動きがボトルネックにならないように、民間を十分に活用することも必要です。

各国の議論内容

ここでは、外国諸国において生成AIについてどのような議論が行われているかみていきましょう。

米国

・AI分野において米国のリーダーシップを強化すべく「米国AIイニシアチブ」に基づき政策を推進。AIに対する過度な規制を制限することを目的とした、米国AI規制原則案を公開

・連法取引委員会や司法省などが連名で、AIが違法な偏見や差別を生む可能性があるとする声明を発表

・副大統領が有力AI企業と面談し、AIの潜在的な危険から社会を守るように要請。同時にAIシステムの公開評価を実施する方針を表明

英国

・言語系生成AIにおけるサイバーセキュリティの留意点を発表

・イノベーション担当省庁が、AIによるイノベーションについてまとめたホワイトペーパーを公開

・競争・市場庁が競争と消費者保護の観点から、レビューを開始した旨を公表

イタリア

・GDPR(日本の個人情報保護法に相当)違反の恐れがあるとして、個人情報保護局はChatGPTの国内利用を一時的に停止するよう命令(その後、一時停止命令は解除)

・副首相はこの一時停止命令が過剰であると批判

ドイツ

・AIに関する危険な開発を抑制する必要があるという声があがる一方で、閣僚から適切に活用すべきとの発言が相次ぐ

・言語系生成AIを正しく活用するための情報提供なども行っている

フランス

・個人情報保護当局などから、雇用への影響に関する強い懸念が示されるなどネガティブな反応が目立つ

EU

・2021年に発表したAI法案に関し、イノベーションを重視した修正案を発表

・欧州委員会の委員会において、より規制を強化した修正案を議決

中国

・「生成式AIサービス管理規制案」に対するパブリックコメントを開始

・本規制案では、生成コンテンツが社会主義的な価値観に沿うべきとし、サービス提供前に当局の審査を求めるとしている

コミュニティ

・⽶国の NPO「Future of LIFE Institute」が公開書簡を公開し、著名なAI研究者も署名。

・本書簡には「リスクが管理可能と確信できる場合のみ開発すべき」「GPT-4より強力なAIの学習を6ヵ月停止すべき」などとまとめられている。

ジョナサン・ブリッグス氏が考えるAI戦略とは?

Hyper Island創立者のジョナサン・ブリッグス氏もまた、生成AIの可能性に大いに注目している1人です。影響を完全に予測することはできないものの、「個人として、また企業として対応を検討する必要がある」と主張しています。

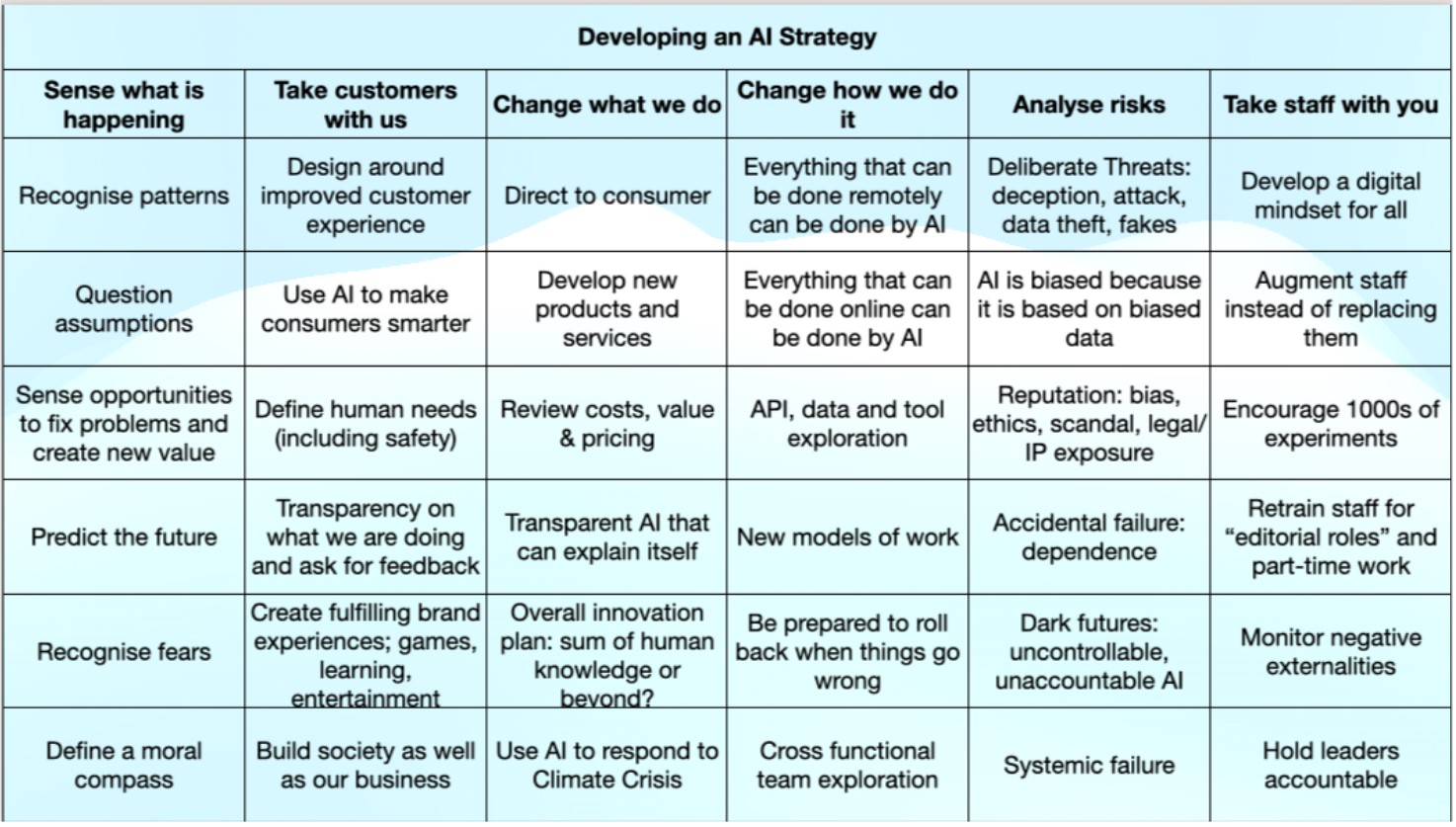

ブリッグス氏は、生成AIの影響を探求する際に役立つツールキットとして、以下戦略シートをまとめました。

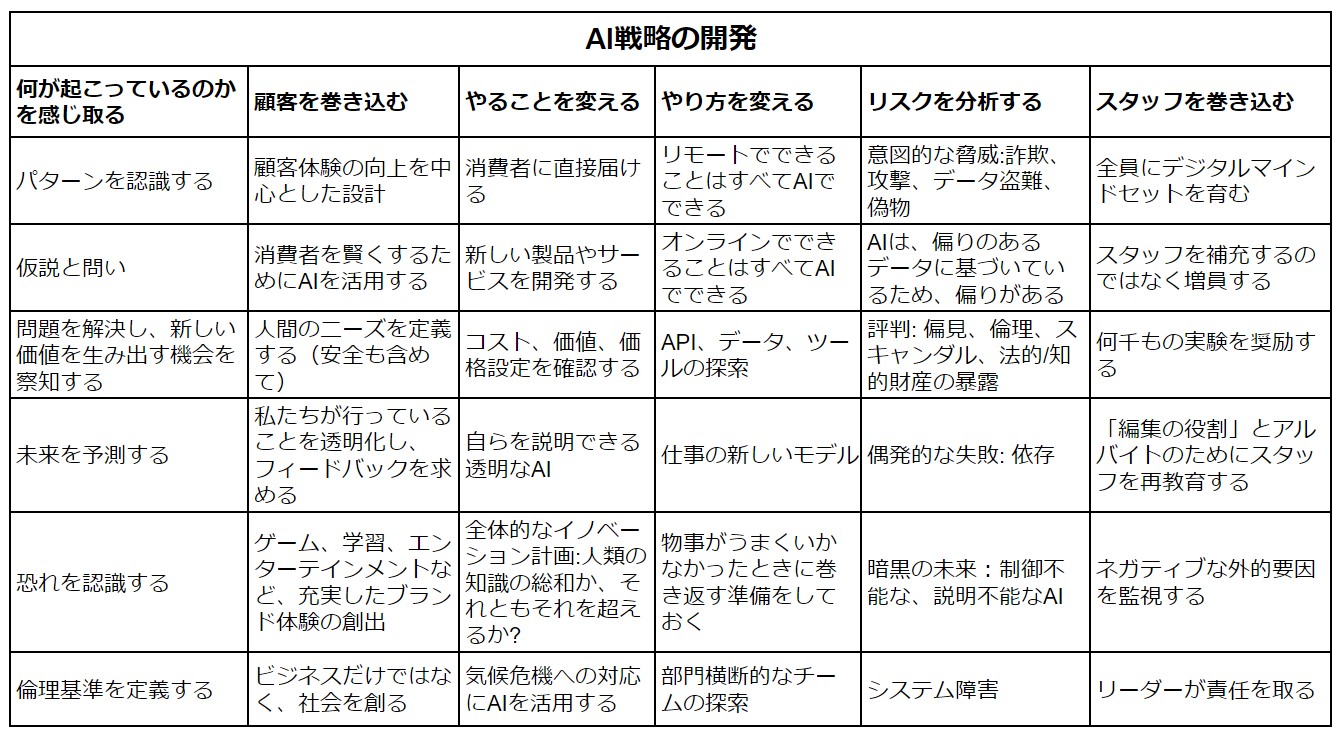

日本語訳は、以下の通りです。

以下、詳しく解説していきます。

2つの構成要素

ブリッグス氏は「センシング」「顧客」という2つの構成要素に分割し、AIについて検討しています。

まず「センシング」についてみていきましょう。AIにはニーズがある一方、AIの利用に対して人々が不安を感じていることや、AI技術には潜在的な副作用があることを認識(感知)すべきです。AIには、現実的なリスクがあります。しかし愚かなSFの世界にインスピレーションを受けたような誤ったリスクはどれで、本当のリスクがどれか見極められていません

AIに仕事を奪われ多くの人が失業に追い込まれたり、悪意のある者の道具として使われたりするのであれば、私たちは解決策を模索すべきです。その上でブリッグス氏は、全ての組織がAIをどのように扱うべきか、道徳的にそれぞれの立場を定義する必要があると提案しています。

次に「顧客」についてみていきましょう。ブリッグス氏は、消費者がより多くのサービスを利用できるようにするため、私たちはビジネスを充実させる必要があると主張しています。全てのサービスが適切に自動化され効率的である上に、人の手を介さず責任を求められることもない世界を想像して下さい。その背景にAIがあるとしても、人間的であるようなブランドや体験を消費者に提供する必要があるのです。

本当のリスクの分析

ChatGPTをはじめとした、さまざまな生成AIツールに存在するリスクの一部が明らかになっています。以下、ブリッグス氏が指摘する生成AIのリスクについてみていきましょう。

・知識の均質化

生成AIの利用によって、個人的な意見や専門知識を識別することが困難になるにつれ、知識が全体的に均質化しています。私たち人間は、個々の才能と創造性を称賛する必要があります。

・悪用

悪意のある者(悪意のある国家など)がAIを利用して欺いたり、盗んだり、破壊したりする可能性があることを認識すべきです。これらを対策するためには、政府と国民による規制や保護を行う必要があります。しかし私たちのリーダーは、このリスクをよく理解していません。個人や企業は彼らがリスクを認識できるように支援すべきです。

・AIの適正利用

私たちがオンラインで実行できる全てのことは、AIでも実行できます。オンラインなら、たとえばショッピング・ギャンブル・取引・フォーム記入・なりすましなど人間だけでなく、AIも実行できるのです。言い換えれば、あらゆるコンピューティングタスクや物理的なアクションは、インターネット上の誰かにより開始・制御できることになります。そのためAIを適正に利用するためには、ChatGPTやBingがAPIでリンクされ、他サービスにメッセージを送れるようにすることが必要です。

・AIによる人材の置き換え

ビジネスにおいて、リモートから実行できるタスクは全てAIで代替が可能です。これによって従業員の仕事が、AIに置き換えられてしまうことになります。AIによって多くの新しい仕事が登場すると考えられますが、AIに仕事を奪われた全ての従業員にすぐに与えられるとは限りません。これによって解雇される様々な企業の従業員は、貴社の顧客になりえることを忘れないでください。失業者が増えれば、経済を壊滅させてしまう程のインパクトとなる可能性もあります。

・バイアス

ビジネスで使うAIは、偏りのあるデータによって学習をするため、バイアスがかかると考えられます。そのためバイアスを発見し適切に対処する方法が必要であり、ChatGPTはその方法を見つける責任があるのです。

・暗い恐怖

現時点で最後のリスクは、私たちがAIという未知のエイリアンを、敵か味方かわからず使い続けていることによる暗い恐怖です。ウイルスを扱う科学研究室では、ウイルスが漏れださないように予防策を講じる必要があることは理解できます。それでは私たちは、AIによって生じたマインドウイルスが、同様の結果をもたらさないように予防策を講じる必要はないのでしょうか。

ここにあげたリスクは全ての人間にあてはまるものや、個人の意思決定やビジネスの選択に影響を与えるものもあります。「包括的な議論を行い、専門家と共に人々が抱くAIに対する不安に基づく対応を検討することが不可欠」というのが、ブリッグス氏の考えです。

ビジネスチャンスを特定する

様々なリスクが考えられる反面、AIは前向きなビジネスチャンスが非常に多いのも事実です。人口動態・気候危機・医療など、私たちが直面している様々な問題のなかには、AIの活躍が待たれる種類も少なくありません。

ブリッグス氏は、「これらの中からビジネスチャンスを特定し、企業がどのように貢献できるか検討する必要がある」と主張しています。さらにビジネスチャンスを成功させるために、スキルアップやリスキリングを行う必要もあるでしょう。週3~4日の柔軟なパートナー契約などの新しい働き方についても検討する必要があります。

AIによって大幅な効率化も実現可能ですが、単に利益を増やして成長を促進するだけでは良くありません。効率性を活かして、息抜きの時間を作ることも求められます。そうでなければ、次の12ヵ月間は健康に仕事ができるかもしれませんが次の10年間は無理です。

まとめ

生成AIとは従来のAIと異なり、テキストや画像、動画などのコンテンツを人間のように作り出せるAIです。生成AIには非常に大きな可能性があり、人間が直面する様々な問題を解決するのに役立つと考えられています。その一方で、人間の仕事が奪われたり犯罪に悪用されたりする可能性があるなど、人々のなかには強い不安があるのも否めません。

いずれにしろ、生成AIは今後世界中で普及していくと考えられます。私たちは生成AIに対する自国や各国の考え方や取り組みを把握し、どのように対応をしていくか検討することが求められているのです。

【参考】

AI に関する暫定的な論点整理 2023年5月26日 AI戦略会議

https://www8.cao.go.jp/cstp/ai/ronten_honbun.pdf

Develop an AI Strategy as part of your Digital Transformation Published by Jonathan Briggs

http://digitaljobstobedone.com/2023/03/31/develop-an-ai-strategy-as-part-of-your-digital-transformation/

UXデザインやサービスデザイン、デジタルデザインなど、海外のデザイン情報、イベント情報を、分かりやすく紹介します。